Quando a gente fala em inteligência artificial hoje, é quase impossível não pensar em redes neurais profundas, modelos gigantescos e máquinas que escrevem, desenham e até conversam conosco. Mas toda essa história não começou agora — e nem começou com computadores poderosos. Ela começa, de forma surpreendente, lá em 1958, com uma ideia simples, ousada e revolucionária: o Perceptron, criado por Frank Rosenblatt.

Eu gosto de pensar no Perceptron como o primeiro momento em que alguém disse seriamente: “e se uma máquina pudesse aprender sozinha?”

O que era o Perceptron?

O Perceptron foi inspirado diretamente no funcionamento do cérebro humano. Rosenblatt tentou imitar o neurônio biológico usando matemática e eletrônica. A ideia era simples:

-

entradas (como sinais),

-

pesos (a importância de cada sinal),

-

uma soma,

-

e uma decisão final: sim ou não.

Em outras palavras, o Perceptron pegava vários dados de entrada, fazia uma conta e decidia se algo pertencia ou não a uma determinada classe. Parece básico hoje, mas naquela época isso era quase ficção científica.

Aprender ajustando erros

O detalhe mais fascinante, na minha opinião, é que o Perceptron aprendia com os próprios erros.

Se ele errava uma classificação, ajustava seus pesos internos para tentar acertar da próxima vez. Isso é aprendizado de máquina em seu estado mais puro.

Nada de regras fixas escritas por humanos para cada situação. O comportamento emergia do treino. Em 1958. 🤯

O hardware também era real

E não era só teoria. Rosenblatt chegou a construir uma máquina física chamada Mark I Perceptron, usando motores, fios, resistores e sensores ópticos. Ele queria que a máquina reconhecesse padrões visuais simples, como letras e formas.

Sim, já se falava em reconhecimento de imagem antes mesmo da popularização dos computadores modernos.

Promessas, críticas e um “inverno”

O Perceptron gerou um entusiasmo enorme. Alguns chegaram a dizer que em breve máquinas seriam capazes de pensar como humanos. Isso, claro, chamou atenção — e também críticas.

Em 1969, Marvin Minsky e Seymour Papert mostraram limitações importantes do Perceptron, como a incapacidade de resolver problemas simples como o XOR. O impacto foi grande. O interesse em redes neurais caiu drasticamente, dando início ao famoso “inverno da IA”.

Mas a ideia não morreu.

O legado que ainda vive

Hoje, quando falamos em redes neurais profundas, com múltiplas camadas e bilhões de parâmetros, estamos basicamente usando Perceptrons empilhados, com algumas décadas de refinamento matemático e computacional.

Tudo isso — absolutamente tudo — nasce daquela pergunta simples feita por Rosenblatt:

Uma máquina pode aprender a partir da experiência?

Por que isso ainda importa?

Porque o Perceptron nos lembra que grandes revoluções começam pequenas. Um modelo extremamente simples, limitado e até criticado, acabou se tornando a base de uma das tecnologias mais transformadoras da história moderna.

Sempre que vejo uma IA reconhecendo imagens, traduzindo textos ou escrevendo códigos, eu lembro:

isso tudo começou com uma máquina que só sabia responder 0 ou 1.

E isso, pra mim, é simplesmente incrível.

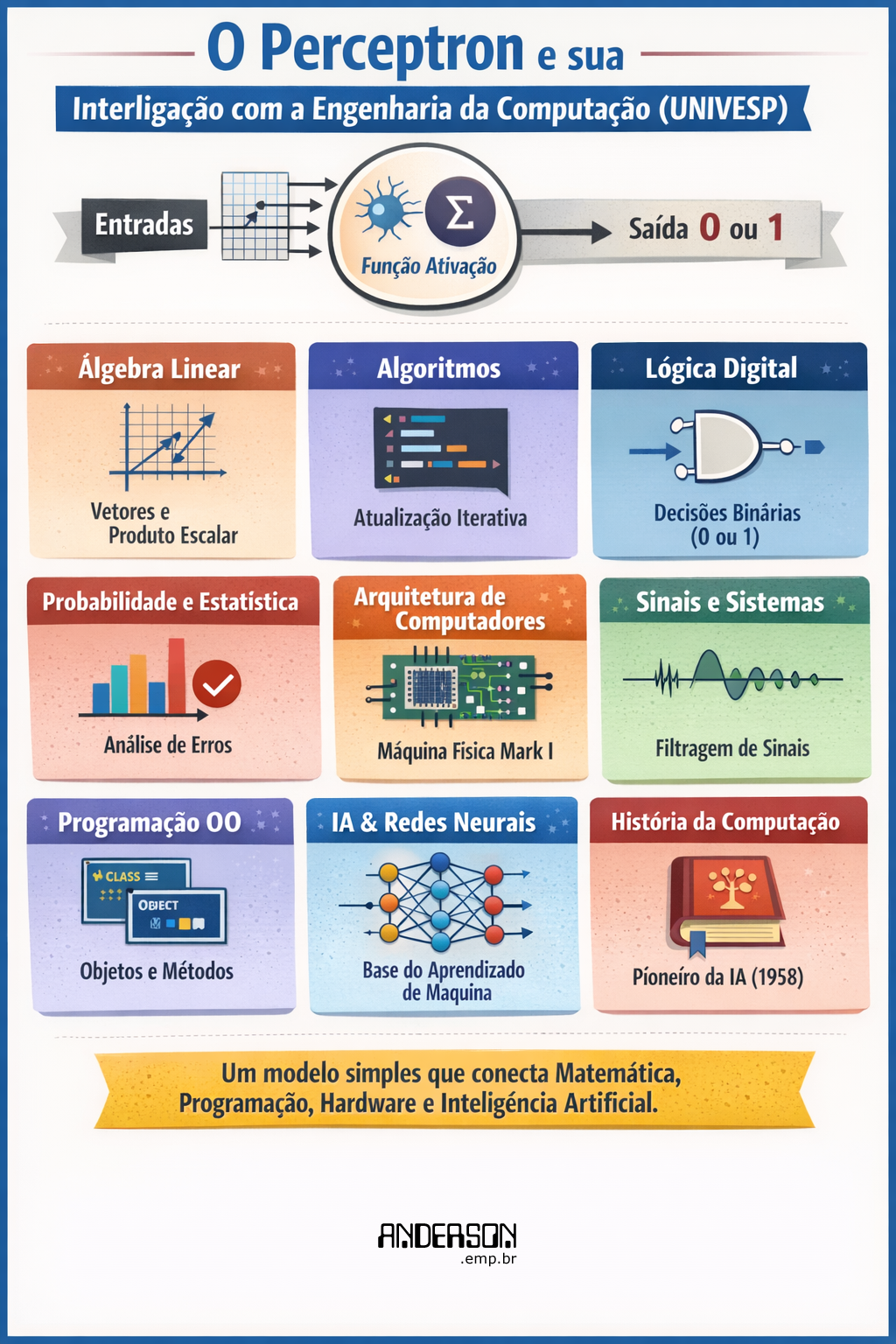

Conexão UNIVESP – Eng. da Computação:

| Área / Disciplina | Conceitos do Curso | Relação com o Perceptron |

|---|---|---|

| Álgebra Linear | Vetores, produto escalar, espaços vetoriais | O Perceptron utiliza vetores de entrada e pesos, realizando um produto escalar para decidir a saída |

| Cálculo | Funções, limites, otimização | A função de ativação e o ajuste dos pesos são baseados em conceitos matemáticos que evoluem para métodos de otimização |

| Probabilidade e Estatística | Classificação, erro, taxa de acerto | O aprendizado do Perceptron depende da análise de erros e acertos durante o treinamento |

| Algoritmos e Programação | Laços, condicionais, atualização iterativa | O algoritmo do Perceptron é um exemplo clássico de aprendizado supervisionado implementável em código |

| Programação Orientada a Objetos | Modelagem, classes e métodos | O Perceptron pode ser modelado como um objeto com entradas, pesos e método de treinamento |

| Lógica Digital | Lógica booleana, decisões binárias | A saída do Perceptron é binária (0 ou 1), semelhante ao funcionamento de circuitos lógicos |

| Sistemas Digitais | Circuitos, comparadores, limiares | O limiar de ativação funciona como um comparador digital |

| Arquitetura de Computadores | Processamento, paralelismo, hardware | O Mark I Perceptron foi uma máquina física, antecipando conceitos de processamento inspirado no cérebro |

| Sinais e Sistemas | Filtragem, resposta a estímulos | O Perceptron pode ser interpretado como um filtro linear de sinais |

| Processamento Digital de Sinais (DSP) | Ponderação de sinais, reconhecimento de padrões | Cada peso do Perceptron atua como um coeficiente de filtragem |

| Inteligência Artificial | Aprendizado de máquina, redes neurais | O Perceptron é a base histórica das redes neurais artificiais modernas |

| Metodologia Científica | Hipóteses, experimentos, validação | O Perceptron exemplifica o ciclo científico: proposta, testes, críticas e evolução |

| História da Computação | Evolução da IA | Representa o primeiro passo concreto rumo às máquinas que aprendem |